記者/吳佩芹

工研院資通所經理王邦傑11日於大同大學的「科技、媒體、組織聯手共同防治不實訊息論壇 」中所演講的主題「變變變-由小玉事件探討DeepFake攻防」,除了藉由小玉事件探討DeepFake外,並說明工研院資通所近年研發的DeepFake辨識技術已達到七成左右。

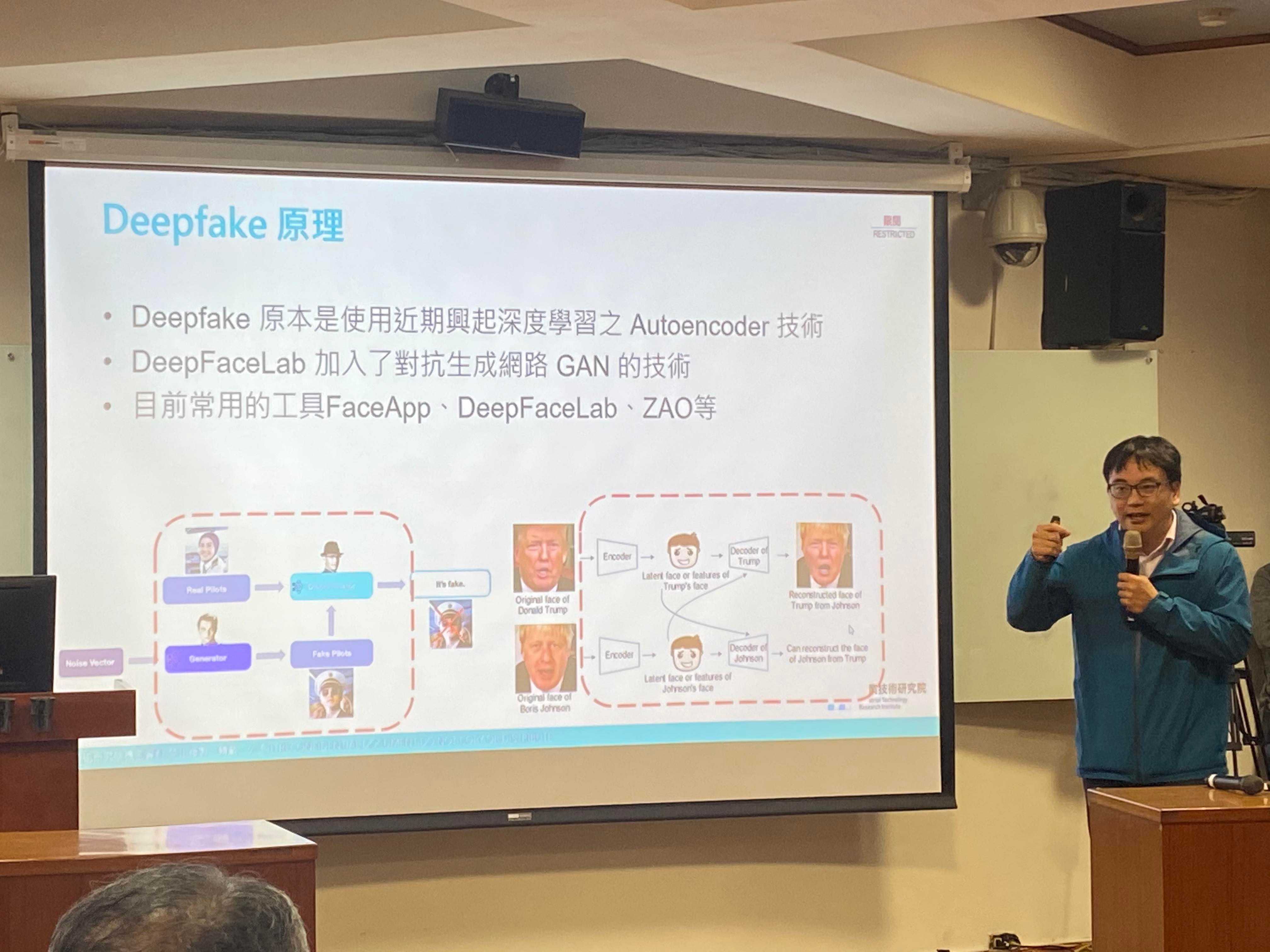

DeepFake這項技術經由小玉事件後廣為人知,但也讓大眾對於這項技術有所誤解,DeepFake除了可以製作造假的影片,還能創造出不一樣的內容,例如虛擬偶像初音未來,或是廣告模特兒等,王邦傑對此表示,技術本身沒有好壞,看用在什麼地方。

王邦傑說,DeepFake真正可怕的地方並不是創造出來的東西有多像真的,因為可以用很多手法達到這個目的,不見得只有AI,但是AI在DeepFake中所扮演的角色是在造假影片產出的過程自動化,若以小玉事件作舉例,只要有某個人的圖像和一段影片匯到程式中就能自動產生造假影片,不再像之前需要慢慢修圖,因此有心人士能透過這項技術製造出大量的造假影片。

王邦傑表示,工研院使用30部小玉的造假影片進行辨識,能辨識出22個造假影片,辨識率高達七成左右。目前已有工具能初步辨識影片是否真假,但源頭該如何處理,要從最大威脅「AI的自動化」著手,若是能破壞AI自動化的過程,就能阻止攻擊方或駭客快速且大量產製造假的影片。而工研院近期設計新的辨識DeepFake模型。

王邦傑現在所屬部門為人工智慧治理,主要負責關於人工智慧的安全與驗證,以及如何攻擊與防禦AI的惡意作法,做到偵測並保護原始的影像,不被DeepFake造假。王邦傑最後說到,工具沒有善惡,技術沒有好壞,未來關注及討論的重點不再是單純的AI技術應用與防範,而是AI的使用是否達到公正、是否能被信任。